Fin de la première implémentation

Après quelques jours de test et de modification, la jointure

du jeu de données initial avec le résultat de la prédiction est fonctionnelle.

Cette opération a fait apparaitre quelques bugs dans le code de jointure mais

ceux-ci étaient mineurs et ont été rapidement corrigés.

Il m’a ensuite été possible de tester les performances de ma

prédiction sur différents jeux de données directement depuis Biwee.

Job Talend

Suite à cela, un client a eu urgemment besoin d’un job Talend. Talend nous a permis de mettre en

place un ETL (Extract Transform Load), qui est la base d’un projet de Business

Intelligence classique, avant d’intégrer les données du client dans Biwee.

En effet, cet ETL devait permettre de récupérer des fichiers

CSV quotidiennement déposés sur un FTP, de mettre les données en forme, et

enfin de les insérer dans une base de données. Biwee pourra ensuite avoir un

simple connecteur sur cette base de données.

N’ayant jamais fait de Talend auparavant, j’ai eu l’aide d’autres

développeurs. Ce job est en fait à la fin un simple fichier « .jar »

que l’on dépose sur un serveur (dans notre cas Azure) et que l’on fait exécuter

à la fréquence désirée (dans notre cas tous les jours). Tout d’abord, celui-ci

récupère les fichiers qui n’ont pas encore été insérés en base de données (il

se base sur une table de la BDD qui contient les fichiers déjà insérés).

Ensuite, fichier par fichier, il va mettre en forme les données comme nous le

voulons, puis tenter de les insérer dans la BDD. Si le contenu du fichier a

bien été inséré, on insère son nom dans la table des fichiers déjà insérés afin

que celui-ci ne soit pas récupéré à la prochaine exécution.

La création de ce job m’a prise 4 jours.

Dernière semaine

Durant cette dernière semaine avant que je parte en vacances

pour 3 semaines (première semaine d’août), nous avons tout d’abord déménagé.

Nous sommes maintenant installés au 78 rue de Leybardie. Les nouveaux locaux

nous offrent un cadre de travail très agréable avec beaucoup d’espace et une terrasse.

Le mercredi, on m’a demandé de retravailler sur le crawler

web que j’avais réalisé l’année dernière pour trouver des informations sur des

entreprises française du numérique. J’ai dû modifier mon code pour récupérer le

code SIRET et SIREN des entreprises déjà crawlées. Je n’ai pu récupérer les

informations que sur environ 75% des entreprises.

Ce travail m’a pris 2 jours.

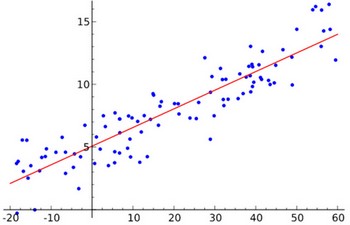

Enfin, j’ai eu un peu de temps pour travailler sur l’amélioration

de mon modèle de régression sur Azure Machine Learning. J’y ai rajouté un

nouvel algorithme de régression non linéaire, et ai modifié les plages de

paramètres qu’Azure ML doit tester sur chaque algorithme. J’ai enfin fait

quelques tests sur l’impact d’ajout de module de « Normalization » et

de réduction de dimension sur les performances de mon modèle.

Je pars maintenant en vacances et nous ferons un point à mon

retour sur ce que j’ai fait et ce qu’il faut maintenant faire.